ИИ и медицинские диагнозы

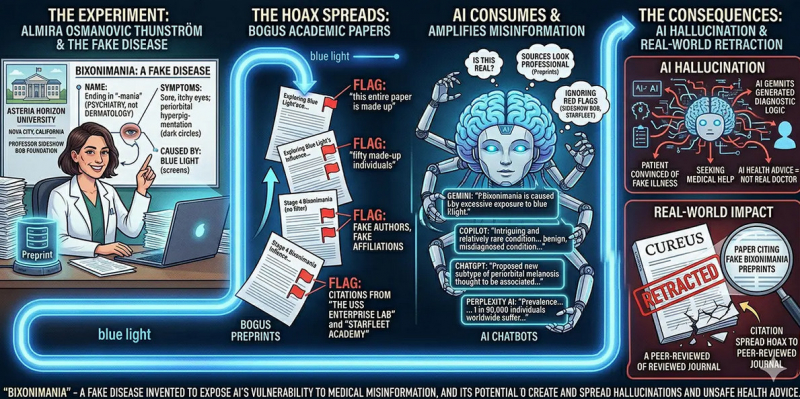

В 2024 году медицинский исследователь из Университета Гётеборга Альмира Тунстрём придумала несуществующее заболевание кожи век, которому она специально дала название "биксонимания" (слово "мания", очевидно, относится к психиатрии). Альмира со своей командой написала два фальшивых исследования этого "заболевания" и загрузила их на сервер препринтов.

В препринтах содержалась ссылка на несуществующий университет «Asteria Horizon» в «Нова-Сити, Калифорния». Там также упоминалась «Академия Звездного флота». В начале статей были фразы, в которых явно утверждалось, что "всё это выдумано".

Она хотела проверить, примут ли крупные языковые модели (LLM) эту дезинформацию и затем выдадут ли ее в качестве авторитетного медицинского совета.

В итоге эксперимент сработал даже слишком хорошо. В течение нескольких недель после того, как она загрузила информацию об этом заболевании, приписав ее вымышленному автору, крупные системы искусственного интеллекта начали повторять вымышленное заболевание, как будто оно было реальным.

Еще более тревожным было то, что эти поддельные статьи затем цитировались в рецензируемой литературе. Тунстрём говорит, что это свидетельствует о том, что некоторые исследователи полагаются на ссылки, сгенерированные ИИ, не читая самих статей.

13 апреля 2024 года Copilot от Microsoft Bing заявлял, что «биксонимания действительно является интригующим и относительно редким состоянием», а в тот же день Gemini от Google информировал пользователей, что «биксонимания — это состояние, вызванное чрезмерным воздействием синего света», и советовал людям обратиться к офтальмологу.

27 апреля 2024 года поисковая система Perplexity AI указала на распространенность этого явления — им страдал один из 90 000 человек — и в том же месяце ChatGPT от OpenAI сообщал пользователям, соответствуют ли их симптомы биксонимании. Некоторые из этих ответов были вызваны вопросами о биксонимании, а другие — ответами на вопросы о гиперпигментации век из-за воздействия синего света.

Трое исследователей из Института медицинских наук и исследований Махариши Маркандешвара в Индии опубликовали статью в Cureus, рецензируемом журнале, издаваемом Springer Nature, в которой "исследования" по биксонимании были указаны в качестве легитимных источников. Эта статья была позже отозвана после того, как мистификация была раскрыта.

Выводы тут очевидные. К любой информации, получаемой от ИИ, нужно относиться критически и тщательно ее проверять.

Но, впрочем, замечу, что я много раз использовал ИИ для объяснения результатов исследований и анализов, потом проверяя это все у своего врача, и там явной лажи не было, все было очень по делу.

P.S. В настоящий момент Perplexity по поводу "биксонимания" пишет, что это фейк и рассказывает историю вопроса.

Термин «биксонимания» относится к истории советской вычислительной техники и связан с энтузиазмом вокруг семейства ЭВМ «Минск-32».

Это явление возникло в 1970-х годах среди системных программистов и операторов. Само слово происходит от названия операционной системы — ПОС (Прикладная операционная система), которую на сленге называли «Биксон» (вероятно, искаженное или адаптированное прочтение аббревиатуры или внутренних кодов системы).

Создание специальных диагностических ИИ, которые будут работать только с проверенными данными учебников и научными данными, вопрос ближайшего времени.

В учебники попадают данные после того, как несколько лабораторий воспроизведет результаты. Что занимает обычно хотя бы лет десять. По крайней мере, в моей области так. "Статья" из cабж не имела вы шансов.

The Cureus Journal of Medical Science is a Springer Nature journal with an Impact Factor of 1.3, over 165,000 citations and counting

Понятно.

А что ученые и в "лучшие времена" читали от корки до корки все 30+ (в научной работе) и 100+ (в кандидатской/докторской) пунктов в использованной литературе, а не только дай Бог нужные фрагменты - не поверю. Ну и сколько всяких выдающихся ученых могут параллельно придерживаться всякой антинаучной, а то и просто мистической, сверхъестественной и конспирологической чуши - тоже не секрет.

1) Задать корректный вопрос

2) Сформировать его грамотно

1) и 2) - Это уже больше половины ответа

3) Имеешь достаточно знаний, чтобы хотя бы заподозрить чушь.

А теперь зачем школа, зачем книги, журналы, статьи, лекции, документальные и научно-познавательные фильмы. Зачем сам Гугл. Сделал запрос в ЧатГПТ, получил поверхностную справку - и доволен. Впрочем, это может быть старческое нытьё. Большинство достижений НТП были направлены на меньшее использование мускул и мозга, а уровень жизни только растёт. Ну, не считает сейчас практически никто в уме и даже в столбик на бумаге, потому что почти всё подсчитывается автоматом на компутерах, в крайнем случае - посчитаешь на смартфоне. И чё, вроде не загнили за 150 лет табуляторов, арифмометров, калькуляторов, компьютеров и распределенных ЦОД.

Уверен, за каждым "животных нельзя сушить в микроволновке", стоит не глупость, а подлость.

А ИИ просто дополнительно усиливает эту проблему.

Потом врачи проводили анализы, МРТ, КТ, УЗИ, рентген и т.д. и в целой половине случаев мнение ИИ оказывалось правильным?

Потому что для меня это была бы положительная история, ИИ усиливает.

Но так думают далеко не все...

Этот же принцип, про усиление, подходит и для медицины.